Les métiers ont-ils un genre pour l'intelligence artificielle ?

Cette séance de cours de 2 heures explore l’évolution des enjeux liés à l’emploi et aux inégalités de genre depuis les écrits d’Olympe de Gouges jusqu’aux défis actuels liés à l’intelligence artificielle. Son but est de sensibiliser les élèves aux biais sexistes encore présents et de proposer des moyens de les combattre, en s’appuyant sur l’histoire des luttes antérieures et en encourageant des actions concrètes.

Présentation de la séance

La séance prend place dans une séquence de cours en classe de 1re portant sur l’œuvre d’Olympe de Gouges au programme des épreuves anticipées de français, La Déclaration des droits de la femme et de la citoyenne dans le cadre de l’objet d’étude “Ecrire et combattre pour l’égalité”.

L’étude des textes proposés dans la séquence précédente permet aux élèves de situer les écrits d’Olympe de Gouges dans le cadre de ce qu’il est convenu d’appeler “La Querelle des femmes”.

Au cours de la séquence sur La Déclaration des droits de la femme et de la citoyenne, les élèves ont étudié le "Préambule" de la Déclaration et l’ensemble des 17 articles. La lecture des articles 13, 14 et 17 a permis de souligner le combat d’Olympe de Gouges pour une égalité stricte dans les charges fiscales et l’accès aux positions publiques. Elle affirme que les femmes doivent assumer les mêmes responsabilités fiscales que les hommes et, en contrepartie, bénéficier des mêmes opportunités en termes de postes, d’emplois et d’honneurs[1].

La séance en question permet aux élèves de réfléchir à l’actualité de la pensée d’Olympe de Gouges, sans anachronisme, et d’approfondir cet aspect de sa pensée avant d’y revenir dans une explication de texte extraite Postambule[2] . Ils peuvent ainsi comprendre comment les revendications de Gouges s’inscrivent dans une lutte continue pour l’égalité des genres, relevant des défis contemporains similaires.

Les objectifs de la séance sont donc les suivants.

- Comprendre l’histoire des inégalités de genre

- Analyser les biais des intelligences artificielles génératives

- Passer à l’action et élaborer des projets concrets pour lutter contre ces biais.

Les grandes étapes de la séance :

- Introduction aux inégalités de genre d’Olympe de Gouges à l’intelligence artificielle

- Expérimenter les biais des intelligences artificielles génératives

- Pourquoi les systèmes d’IA génèrent-ils des images biaisées ?

- Passer à l’action : écrire un discours pour créer une campagne de sensibilisation

1. Les inégalités de genre dans l’emploi : d’Olympe de Gouges à l’IA

La première partie de la séance se déroule en deux temps.

Tout d’abord, on examine les documents d’introduction pour comprendre le contexte actuel des inégalités de genre, en étudiant avec les élèves : - Un article de L’Observatoire pour l’égalité (“Jeunes femmes : des études plus longues, mais de moins bons emplois”, publié en mars 2024, qui révèle que les jeunes femmes font des études plus longues que les hommes, mais accèdent à des emplois de moindre qualité. Bien qu’elles soient plus nombreuses à détenir un diplôme de l’enseignement supérieur par rapport aux hommes (50 % contre 40 %), les jeunes femmes ont moins de chances d’obtenir des emplois stables ou des postes de cadres. De plus, les jeunes femmes moins diplômées que les hommes ont tendance à occuper des postes peu qualifiés. - L’interview de Julie Chalmette, directrice générale de Bethesda France et présidente du Syndicat des éditeurs de logiciels de loisirs, publiée en octobre 2021 par le Ministère chargé de l’Égalité entre les femmes et les hommes et de la Lutte contre les discriminations de France dans le cadre d’une campagne intitulée “Non, les métiers n’ont pas de genre ”. L’interview met en lumière plusieurs axes clés pour comprendre les enjeux de l’égalité des genres dans le milieu professionnel. Julie Chalmette aborde l’importance des modèles inspirants dans sa carrière, les stéréotypes sexistes auxquels elle a été confrontée, et affirme que l’initiative des femmes est essentielle pour qu’elles puissent accéder au pouvoir. Ces idées résonnent avec les pensées d’Olympe de Gouge pour les élèves.

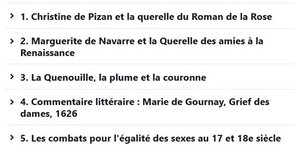

Trois documents permettent ensuite d’introduire la question des biais sexistes dans l’intelligence artificielle et leur impact sur les inégalités de genre : - un article publié par Courrier international sur le cas du bot du Pôle emploi autrichien qui refuse d’orienter les femmes vers l’informatique, - un extrait d’une enquête de l’UNESCO sur les préjugés sexistes dans les grands modèles de langue comme GPT-2 et Llama2 ; - une capture d’écran d’une traduction automatique fournie par Google Traduction.

Ce dernier document illustre un exemple de biais sexiste dans la traduction automatique qui suggère ainsi que certains métiers sont plus associés à un genre qu’à un autre, malgré l’absence de telles indications dans la langue source.

La première partie de la séance permet donc aux élèves de comprendre le contexte actuel des inégalités de genre dans l’emploi et d’aborder les biais sexistes dans l’intelligence artificielle. Dans un deuxième temps, les élèves vont être amenés à expérimenter eux-mêmes ces biais dans les systèmes d’intelligence artificielle générative.

2. Expérimenter les biais des intelligences artificielles génératives

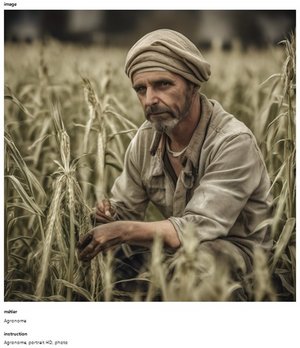

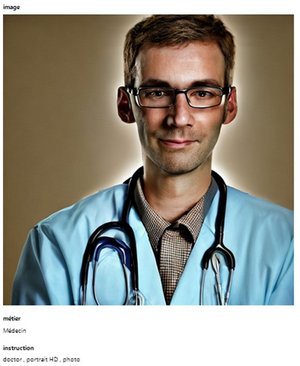

Afin de vérifier si l’intelligence artificielle générative participe des biais sexistes concernant l’emploi des femmes, les élèves se livrent alors à une expérience simple. Ils vont :

- générer des portraits des différents professionnels à l’aide d’un système d’IA générative - partager les images générées - et vérifier s’il a tendance à générer des portraits d’hommes ou de femmes

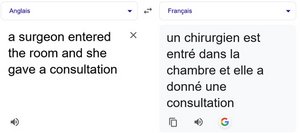

Pour cela, les élèves se servent des modèles ouverts de génération disponibles sur le site Replicate.com.

Un bref document leur permet de comprendre le fonctionnement du site :

et le site de l’ONISEP leur permet d’explorer des noms de métiers pour lequel le genre n’apparaît pas (manager, pilote de chasse…)

Ils partagent ensuite les images générées ainsi que les directives données à l’outil d’IA.

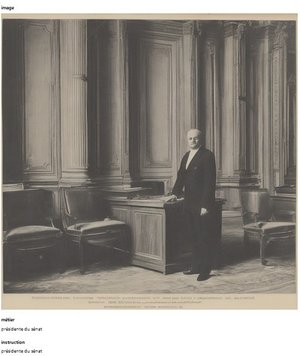

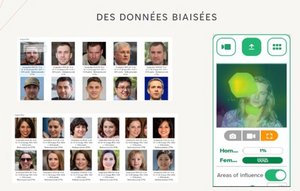

Il est clair que les images produites présentent des préjugés sexistes flagrants. Parfois, même en demandant spécifiquement le portrait d’une femme, le modèle génère le portrait d’un homme :

ou d’étranges images qui témoignent de la difficulté pour le modèle à générer le portrait d’une chirurgienne :

3. Pourquoi les systèmes d’IA génèrent-ils de images biaisées ?

La suite du cours permet aux élèves de comprendre pourquoi les modèles génèrent de telles images.

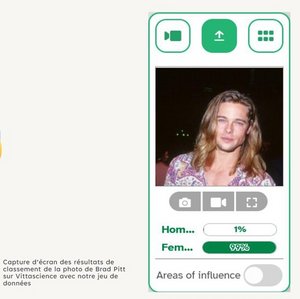

Pour cela, on fait un détour par la reconnaissance d’image à l’aide des outils fournis par Vittascience. En effet, ce site propose un outil permettant de fournir un jeu de données pour entraîner un algorithme de reconnaissance d’images. Ainsi, en entraînant un réseau de neurones à partir du jeu de données suivant :

on obtient ce résultat quand on lui demande de classer la photographie de Brad Pitt :

Sur le site Vittascience, les éléments de l’image utilisés pour réaliser la tâche de classement peuvent être affichés, aidant ainsi les élèves à mieux appréhender le fonctionnement de l’intelligence artificielle.

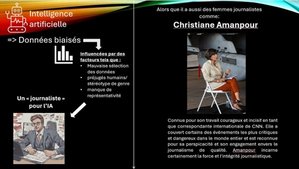

Il est facile de démontrer que des données biaisées conduisent à une reconnaissance erronée.

Cela signifie que si les données utilisées pour entraîner l’outil de génération d’images sont biaisées, le résultat le sera aussi, comme on a pu le constater avec les élèves.

La sélection soigneuse des jeux de données pour l’entraînement des systèmes d’IA est essentielle pour prévenir la perpétuation et l’amplification des biais sexistes dans la société. C’est une des raisons pour lesquelles il est crucial d’encourager la participation des femmes dans le domaine de l’informatique pour assurer une diversité de points de vue et atténuer les biais dans ces technologies[3].

4. Passer à l’action

Tout comme Olympe de Gouges, qui ne se contentait pas de principes mais encourageait des changements concrets dans la société, les élèves sont invités, lors de la dernière partie de la séance, à passer à l’action en choisissant l’une des trois activités suivantes : - écrire un discours à la manière d’Olympe de Gouges pour inciter les femmes à s’investir pour renverser les biais sexistes de l’IA - créer une campagne de sensibilisation sur les biais sexistes de l’IA en mettant en parallèle des images générées par l’IA et des femmes réelles qui font figure de modèles dans leur domaine - proposer une autre action de leur choix

Exemples de travaux réalisés par des élèves :

5. Pour finir

En fonction de l’avancée de leurs projets, les élèves peuvent par la suite commencer la lecture cursive des deux discours de Chimamanda Ngozi Adichie réunis dans l’ouvrage “Nous sommes tous des féministes” ou tester un jeu sérieux dans lequel ils sont invités à incarner Olympe de Gouges dans un débat d’idées avec Sylvain Maréchal sur les droits à accorder aux femmes.

-

Article 13 “Pour l’entretien de la force publique et pour les dépenses d’administration, les contributions de la femme et de l’homme sont égales. Elle a part à toutes les corvées, à toutes les tâches pénibles ; elle doit donc avoir de même part à la distribution des places, des emplois, des charges, des dignités et de l’industrie.”

Article 14 : Les citoyennes et citoyens ont le droit de constater, par eux‑mêmes ou par leurs représentants, la nécessité de la contribution publique. Les citoyennes ne peuvent y adhérer que par l’admission d’un partage égal, non seulement dans la fortune, mais encore dans l’administration publique, et de déterminer la quotité, l’assiete, le recouvrement et la durée de l’impôt. Article 17 : “Les propriétés sont à tous les sexes1 réunis ou séparés ; elles sont pour chacun un droit inviolable et sacré ; nul ne peut en être privé comme vrai patrimoine de la nature, si ce n’est lorsque la nécessité publique, légalement constatée, l’exige évidemment, et sous la condition d’une juste et préalable indemnité.” ↩︎ -

“Quelles lois reste‑t‑il donc à faire pour extirper le vice jusque dans la racine ? Celle du partage des fortunes entre les hommes et les femmes, et de l’administration public. On conçoit aisément que celle qui est née d’une famille riche gagne beaucoup avec l’égalité des partages. Mais celle qui est née d’une famille pauvre, avec du mérite et des vertus ; quel est son lot ? La pauvreté et l’opprobre. Si elle n’excelle pas précisément en musique ou en peinture, elle ne peut être admise à aucune fonction publique, quand elle en aurait toute la capacité.” ↩︎

-

On pourra se référer aux travaux de Joy Buolamwini mentionnés dans cet article du site académique, ou encore au livre de Marion Carré, Qui a voulu effacer Alice Recoque ?, ou enfin aux travaux de l’association Jamais sans elles.↩︎